카메라의 중요성을 강조할 때 종종 인간의 눈에 비유하곤 한다. 눈의 중요성에 대해서는 두말할 필요가 없겠지만, 눈의 출현은 지구 역사를 바꿀 정도로 획기적인 사건이었다. 지금으로부터 5억 4,000만 년 전 눈을 가진 생명체가 지구상에 새롭게 등장했을 때, 이들은 눈을 이용해 천적을 피하고, 먹이를 쉽게 구하며, 다양한 종으로 진화하게 됐다.* 이는 마침내 3개의 동물군이 38개로 폭발적으로 증가하는 캄브리아 대폭발이라는 지질학적 사건으로 이어졌다.

* Andrew Parker ‘In the Blink of an Eye: How Vision Sparked the Big Bang of Evolution’, 2003(https://www.theage.com.au/national/the-eyes-might-have-it-20030830-gdw96w.html)

이와 유사한 시각적 혁신이 10여 년 전 스마트폰에서 이뤄졌다. 고성능 카메라를 장착한 스마트폰이 등장하면서 사람들은 시각 정보를 기반으로 사진 공유, 영상 통화 등 기존과 다른 방식으로 소통하기 시작했다. 이후 카메라에 기반한 새로운 애플리케이션과 서비스가 폭발적으로 증가해, 오늘날과 같은 모바일 세상이 탄생하게 됐다. 특히 올해는 코로나19 바이러스 확산 여파로 비대면 환경으로의 디지털 전환이 가속됐고, 이제 화상 회의와 온라인 수업은 우리의 일상이 됐다.

‘카메라의 망막’ CIS 기술 발전, 스마트폰 카메라 전성시대 열다

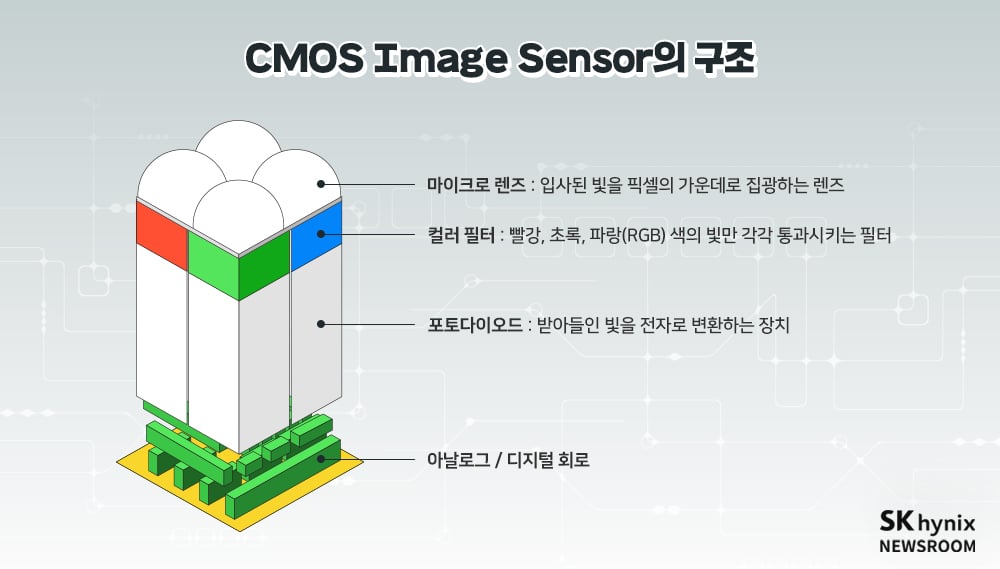

기술 측면에서 스마트폰 카메라는 렌즈(Lens), 적외선 차단 필터(Infrared Cut-off Filter)*, 자동 초점 장치(Auto Focusing Actuator)*, CIS(CMOS Image Sensor)* 등 여러 가지 부품으로 구성돼 있다. 이 가운데 CIS는 사람 눈의 망막 역할을 하는 핵심 부품으로서 위 그림과 같이 빛을 전자로 변환하는 포토다이오드(Photodiode), 특정 파장의 빛만 통과시키는 컬러 필터(Color Filter), 전자를 디지털 신호로 변환하는 아날로그(Analog)/디지털(Digital) 회로, 보정과 영상 처리를 담당하는 ISP(Image Signal Processor) 등으로 구성돼 있다.

* 적외선 차단 필터(Infrared Cut-off Filter): 적외선 영역을 차단하고 가시광선 영역을 통과시키는 소자

* 자동 초점 장치(Auto Focusing Actuator): 모터를 활용해 자동으로 초점을 맞춰주는 장치

* CIS(CMOS Image Sensor): 채널이 다른 모스(MOS) 집적 회로를 짜맞춰 구성한 ‘상보성 금속 산화물 반도체(CMOS)’ 구조를 가진 촬상소자(빛을 감지해 전기 신호로 변환하는 소자). 소비 전력이 매우 적고, 스마트폰 카메라 등 촬영용 전자기기에서 일종의 전자 필름 역할을 한다.

CIS 성능에 의해 영상의 해상도, 감도, SNR(Signal-to-Noise Ratio)* 등이 결정되므로 스마트폰 카메라의 화질은 CIS에 의해 결정된다고 해도 과언이 아니다. 오늘날 스마트폰 카메라의 CIS 화질은 콤팩트 디지털 카메라(Compact Digital Camera) 수준을 넘어섰고, DSLR과의 차이도 지속적으로 좁혀가는 추세다.**

* SNR(Signal-to-Noise Ratio): 신호 대 잡음 비. 20 log(signal/noise)로 정의됨

** DXO Mark ‘Smartphones vs Cameras: Closing the gap on image quality’, 2020(https://www.dxomark.com/smartphones-vs-cameras-closing-the-gap-on-image-quality/)

성능 측면에서 CIS는 화소(畵素, Pixel)를 높이고 기능을 강화하는 방향으로 발전해 왔다. 스마트폰 카메라가 등장한 이후 지금까지는 화소 경쟁이 치열했다. 화소 숫자가 증가할수록 세밀하고 선명한 화질을 얻을 수 있기 때문이다. BSI(Back Side Illumination)* , DTI(Deep Trench Isolation)* 등 반도체 미세 공정의 혁신을 통해 동일한 면적에 더 많은 화소를 집적할 수 있게 됐고, 그 덕분에 이제는 일반적인 스마트폰으로도 수천만 화소의 영상을 쉽게 찍을 수 있게 됐다.

* BSI(Back Side Illumination): 빛을 센서 후면부에서 받아들임으로써 포토다이오드에 입사되는 수광량을 높이는 기술. 빛이 센서 전면부에서 입사되는 경우에는 금속 배선에 의한 산란으로 광 손실 발생

* DTI(Deep Trench Isolation): 화소 간의 신호 간섭을 방지하기 위해 실리콘 내부의 인접한 포토다이오드 사이에 물리적인 격벽을 만드는 공정 기술

CIS의 최신 기술 트렌드는? 화소 경쟁의 시대 가고, 기능 경쟁의 시대 온다

하지만 CIS의 화소를 높이는 방식의 시도는 조만간 기술적 어려움에 직면할 것으로 예상되며, 이로 인해 앞으로는 ISP를 중심으로 기능을 강화하는 방향으로 경쟁 양상이 바뀔 것으로 전망된다. 그 이유는 다음과 같다.

첫째, ‘회절 한계’*로 인해 CIS 화소 미세화에는 한계가 존재하기 때문이다. CIS는 마이크로 렌즈와 같은 광학 기술이 소자나 회로와 같은 반도체 기술과 결합된 복합적인 부품이다. 현재의 반도체 기술로도 전자 회로의 선폭을 nm(나노미터) 단위까지 줄이는 것은 가능하다. 하지만 화소의 크기가 작아질수록 수광량(受光量, 빛을 받는 양)이 감소해 감도가 저하되고, 신호의 크기가 줄어 SNR이 저하되기 때문에 화질 열화(劣化)가 발생한다.

* 회절 한계: 회절(回折)은 빛이 진행할 때 장애물을 만나면 직진 경로가 아닌 휘어진 경로로 진행하는 현상을 의미하는데, 이때 회절 한계란 육안으로 회절이 일어난 것인지, 일어나지 않은 것인지 판별하기 힘든 한계를 의미한다.

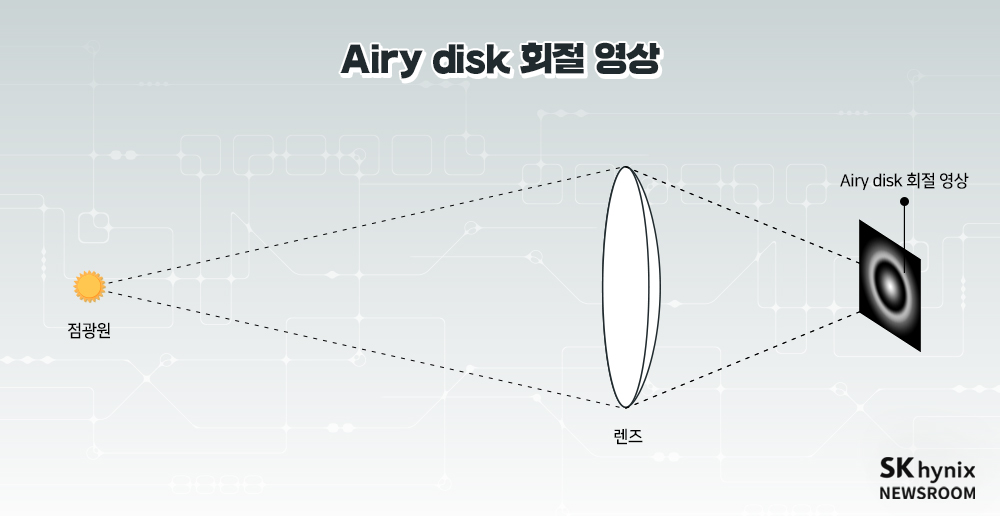

또한 카메라의 광학계는 회절 효과*에 의해 성능이 제한되는 물리적 한계가 존재하며, 하나의 점광원*을 찍더라도 렌즈를 통해 CIS에 맺히는 화상영상은 위 그림과 같이 퍼져 보이게 된다. 이것을 ‘Airy disk’* 라고 부르는데, 빛의 파장(λ), 초점 거리(f), 렌즈 직경(d)이 주어졌을 때, 두 점을 분리할 수 있는 거리(x)는 아래 식으로 결정된다.**

* 회절 효과: 빛이 진행할 때 장애물을 만나면 직진 경로가 아닌 휘어진 경로로 진행하는 현상

* 점광원: 크기와 형태가 없이 하나의 점으로 보이는 광원(光源)

* Airy disk: 하나의 점광원이 렌즈를 통해 CIS에 맺힐 때 영상이 퍼져보이는 현상

** Wikipedia, Airy disk(https://en.wikipedia.org/wiki/Airy_disk)

x = 1.22(λ*f)/d

예를 들면 400nm의 청색 점광원에 대해 F(=f/d)값이 1.4인 고성능 렌즈를 쓰더라도 두 점을 분리할 수 있는 거리는 0.68μm(마이크로미터)가 된다. 즉, 청색 점광원 두 개를 구분하기 위해서는 적어도 0.68μm 이상 떨어져 있어야 한다는 의미로, CIS의 화소를 이보다 작게 만든다고 하더라도 실질적인 해상도 향상을 기대하기는 어렵다. 현재 상용화된 CIS 화소의 크기가 이미 0.7~0.8μm에 도달했기 때문에 이보다 더 작은 화소로부터 효용 가치를 얻기 위해서는 초점 간 거리인 F값을 줄이기 위한 새로운 광학 기술을 개발하거나 여러 개의 미세 화소를 묶어서 사용하는 것과 같은 새로운 애플리케이션을 개발해야 한다.

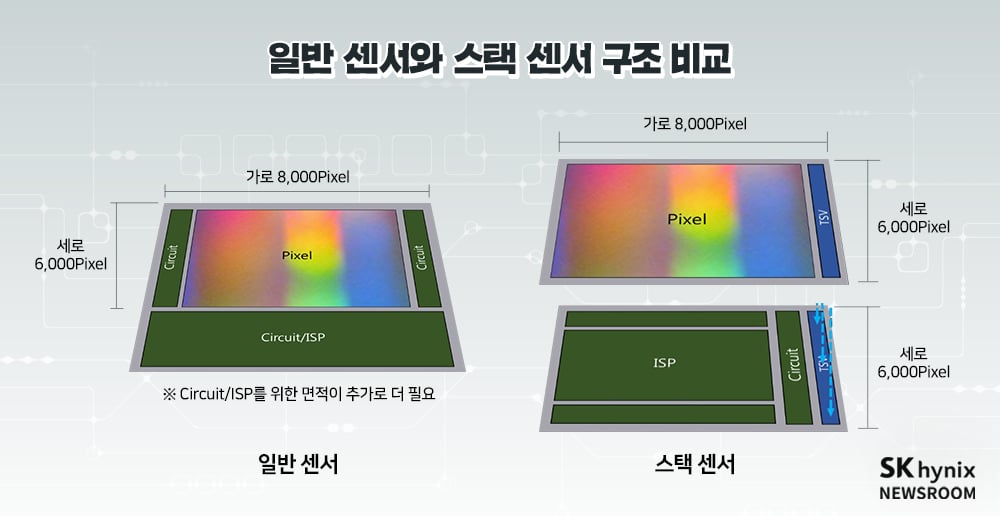

둘째, 스택 센서(Stack Sensor) 기술의 출현이다. 재래식 센서는 화소와 회로를 동일한 기판에서 구현하는 구조로, CIS를 작게 제작하기 위해서는 비수광부(非受光部, 빛을 받지 않는 부분)의 면적을 줄여야 했다. 이로 인해 아날로그/디지털 회로의 필수적인 기능만 구현할 수 있었고, 부가 기능을 위한 회로를 추가하는 것도 매우 제한적이었다.

반면, 스택 센서는 위 그림과 같이 화소와 회로를 별도의 기판에서 구현한 다음, TSV(Through Silicon Via)* 또는 Hybrid bonding* 기술로 두 개의 기판을 전기적으로 연결하는 구조를 가진다. 화소와 회로가 포개어져 상판 화소가 차지하는 면적만큼 하판 회로를 사용할 수 있다. 그만큼 활용할 수 있는 면적이 넓다.

* TSV(Through Silicon Via): 2개 이상의 실리콘 웨이퍼를 관통하는 전극을 형성해 웨이퍼 사이에서 전기적 신호를 전달하는 공정 기술

* Hybrid bonding: 실리콘 웨이퍼를 관통하는 전극 대신, 두 개 웨이퍼의 상단 표면에 금속 전극을 미리 형성한 후 이를 맞붙여서 두 웨이퍼를 전기적으로 연결하는 공정 기술. 성능은 높이면서 크기를 줄일 수 있음

예를 들어 1μm 화소로 구현된 4,800만 화소(8000×6000)의 센서 크기는 상판 화소가 48㎟ 이상의 면적을 차지하게 되는데, 하판 회로에서 이 면적을 디지털 로직(Digital Logic) 구현에 사용한다면 고성능 마이크로프로세서(microprocessor)*를 다수 집적할 수 있을 정도의 여유 있는 공간을 활용할 수 있다.

* 고성능 마이크로프로세서(microprocessor): 연산 장치와 중앙 처리 장치의 제어 기능을 하나의 칩 속에 집적한 소자

또한 스택 센서는 상판 화소와 하판 회로에 독립적인 공정을 적용할 수 있다는 장점을 갖고 있다. 하판 회로에 상판 화소 공정 대비 초미세 로직 공정*을 적용하면, 복잡한 ISP 알고리즘도 저전력·고집적 디지털 회로로 구현할 수 있다. 재래식 센서의 ISP는 회로 면적 제한으로 인해 렌즈 보정, 결함 보정과 같은 단순 기능만을 지원했지만, 스택 센서의 ISP는 초미세 로직 공정을 활용해 영상 처리, 컴퓨터 비전, 인공지능(Artificial Intelligence, AI)과 같은 혁신적인 알고리즘을 구현할 수 있게 된 것.

* 로직 공정: AND, OR, NOT과 같은 논리 연산을 처리하기 위한 디지털 소자를 제조하는 반도체 공정

SK하이닉스의 CIS가 특별한 이유는? 다양한 기능 갖춘 ‘다재다능함’

현재 SK 하이닉스 CIS는 PDAF(Phase Detection Auto Focus), Quad 화소 처리, HDR(High Dynamic Range) 처리와 같은 영상 처리 기능을 내장하고 있으며, 새로운 기능들을 지속적으로 추가하고 있다.

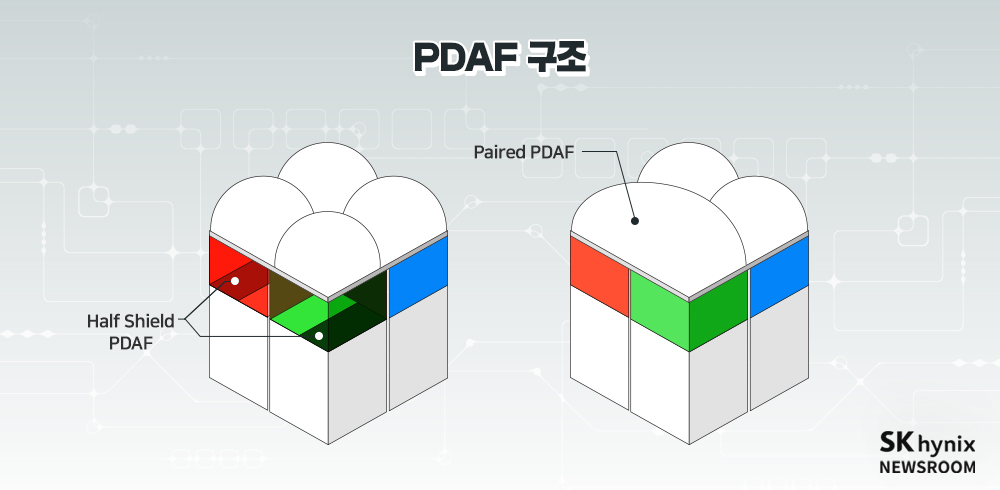

우선, PDAF는 사람이 양쪽 눈을 이용해 피사체까지 거리를 예측하는 원리를 응용한 기능이다. 즉, CIS의 일부 화소에 대해 위 그림 왼쪽과 같이 좌우를 가려 위상차(Phase difference)*를 발생시키거나, 오른쪽과 같이 하나의 큰 마이크로 렌즈 하부에 좌우 화소를 배치해 위상차를 발생시키는 방식이다. 이때 ISP 알고리즘은 좌우 이미지로부터 위상차를 계산하고 이를 피사체까지 거리로 변환해, 빠르고 정확하게 초점을 맞출 수 있다.

* 위상차(Phase difference): 두 개의 진동(파동)에 대한 위상의 차이. 이때 위상은 임의의 기점에서 본 진동(파동)의 상대적인 위치를 의미한다.

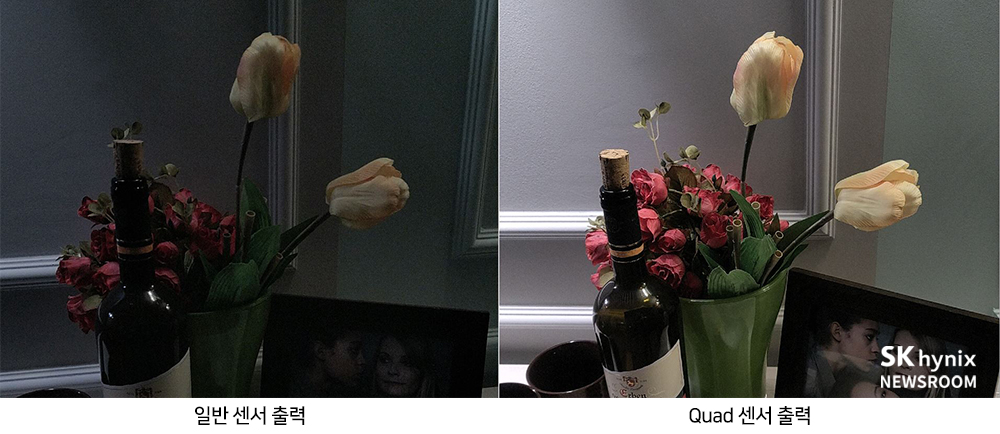

다음으로, Quad 센서는 동일한 색상의 컬러 필터 네 개를 인접하게 배치해 함께 처리하는 기능을 갖고 있다. 어두운 곳에서는 네 개의 화소를 합쳐 더 많은 빛을 받아들이도록 처리하고, 밝은 곳에서는 ISP 알고리즘으로 개별 화소를 따로 처리해 해상도를 향상시킨다. 위 그림은 어두운 배경의 같은 장면을 SK하이닉스의 4,800만 화소 CIS의 Quad 센서와 일반 센서로 각각 촬영한 영상이다. 일반 센서와 비교할 때, Quad 센서를 사용하면 어두운 곳에서도 밝은 영상을 얻는 것이 가능하다.

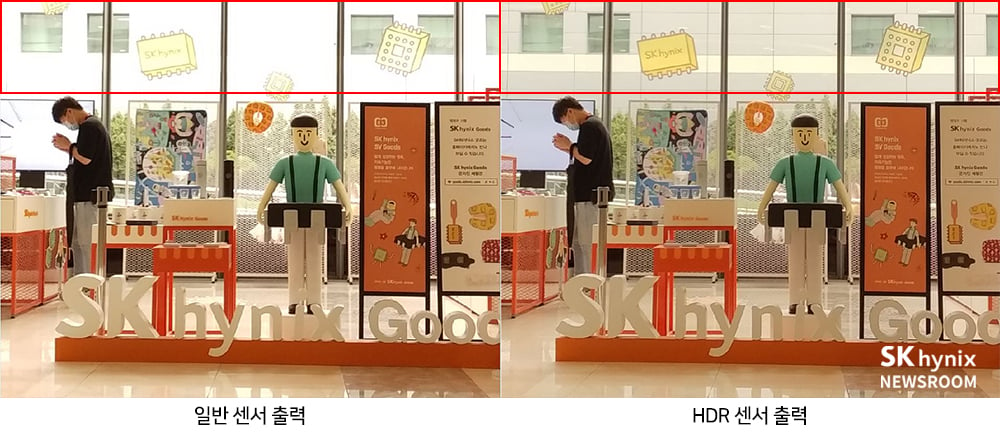

끝으로, HDR 센서는 감도와 노출시간이 다른 여러 개의 화소를 합성해, 영상의 밝은 부분과 어두운 부분을 더욱 선명하게 대비하는 기능을 지원한다. 특히 SK 하이닉스 CIS는 내장 ISP에서 영상 처리가 이뤄지기 때문에 실시간 처리가 가능하고, 움직이는 물체가 있더라도 선명한 화질을 얻을 수 있다. 위 그림은 같은 장면을 SK 하이닉스 CIS의 HDR 센서와 일반 센서로 각각 촬영한 영상이다. 일반 센서와 비교할 때, HDR 센서를 사용한 영상은 전경의 밝기를 동일하게 유지하면서 배경을 선명하게 복원한다.

현재 SK 하이닉스의 CIS는 블랙펄(Black Pearl) 제품 라인업을 필두로 스마트폰 카메라에 광범위하게 사용되고 있으며, 가까운 시일 내에 바이오, 보안, 자율주행 자동차 등 다양한 분야로 확장될 전망이다.

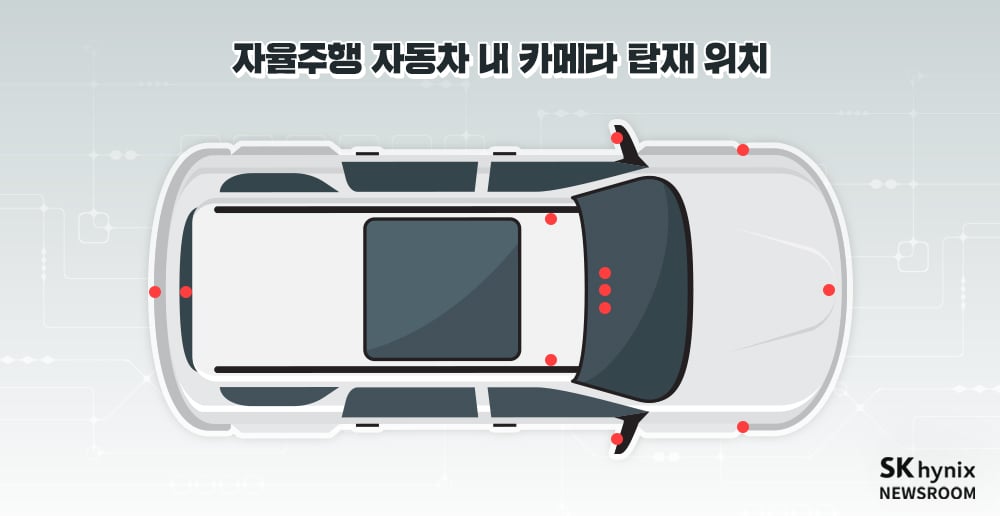

특히 자율주행 자동차는 10개 이상의 카메라를 활용해 주변을 감지하게 되는데,* 정확도를 향상시키기 위해서는 △멀리 있는 물체를 구분하기 위한 고해상도 지원 △어두운 환경에서도 사물을 분간하기 위한 HDR 지원 △프로세서의 연산량을 줄이기 위한 ISP에서의 전처리 등의 요구 사항을 만족시켜야 한다.

* Peter Brown ‘Breaking Down the Sensors Used in Self-Driving Cars, 2018(https://electronics360.globalspec.com/article/12563/breaking-down-the-sensors-used-in-self-driving-cars)

보안 분야에서는 CIS 내장 ISP에서 영상 신호를 압축하고 암호화해 외부 프로세서에 전달하는 기능이 필요하다. 암호화되지 않은 영상 신호가 그대로 외부로 전달된다면 보안 취약성과 정보 유출 가능성이 커지기 때문에 CIS 내부의 암호화 기능은 필수적이다.

CIS의 미래는? 고도의 부가 기능 지원하는 ‘인포메이션 센서’

미래의 CIS는 화질 향상에 국한되지 않고 고도의 부가 기능을 지원하는 인포메이션 센서(Information Sensor)로 진화할 것이다. SK 하이닉스의 스택 센서는 이미 초미세 공정을 기반으로 하판 ISP 내부에 간단한 AI Hardware Engine을 내장하는 것이 가능한 수준에 이르렀다. SK 하이닉스는 이를 바탕으로 머신 러닝(Machine Learning) 기반의 ‘Super Resolution’*, 색상 복원, 얼굴 인식, 사물 인식 등 새로운 기술들을 개발하고 있다.

* Super Resolution:저해상도 영상을 고해상도 영상으로 변환하는 기술. 머신 러닝 기술을 활용하면 영상의 디테일을 잘 복원할 수 있기 때문에 선명한 영상을 얻을 수 있음

머신 러닝 기반의 ISP 기술을 활용하면 입력 영상으로부터 특징을 추출하고 분류하는 것이 가능해, CIS는 영상 정보, 위치 정보, 거리 정보, 생체 정보 등 다양한 정보를 수집하는 인포메이션 센서의 핵심 부품으로 자리 잡을 것이다.

특히 CIS를 인포메이션 센서로 활용하기 위해서는 현재와는 다른 관점에서 접근해야 한다. 지금까지 CIS의 화질 목표는 ‘사람의 눈에 최적화된 화질을 달성하는 것’이었으나 향후에는 ‘기계 알고리즘에 최적화된 화질을 달성하는 것’으로 변화해야 하기 때문.

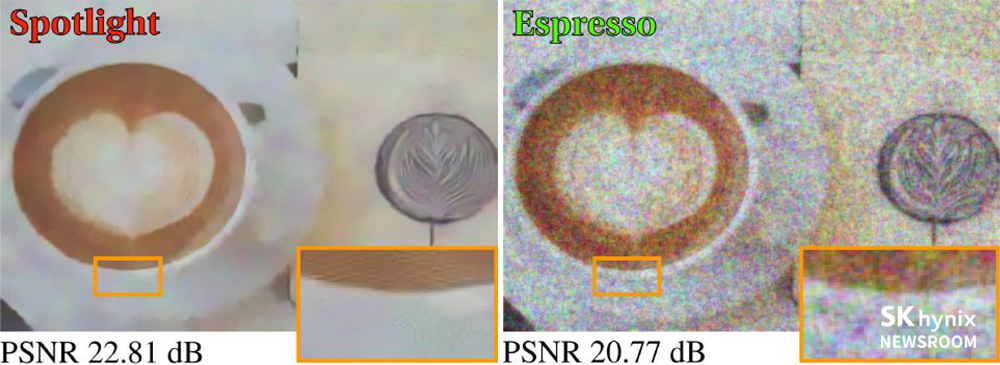

스탠퍼드 대학교(Stanford University)의 연구 결과에 따르면, 복잡한 영상 처리를 해 사람 눈에 보기 좋은 영상을 만든다고 하더라도 컴퓨터 비전 알고리즘을 적용했을 때 항상 우수한 결과를 도출하지는 못한다. 예를 들면 위 그림처럼 커피 컵 영상에 장면 인식 알고리즘을 적용했을 때 노이즈가 적은 좌측 영상은 기계에서 스포트라이트로 잘못 인식되지만, 오히려 노이즈가 많은 우측 영상이 에스프레소로 정확하게 인식된다. 따라서 미래의 CIS는 사용하고자 하는 컴퓨터 알고리즘에 최적화된 화질을 제공하는 것이 중요하다.*

* Diamond, V. Sitzmann, S. Boyd, G. Wetzstein, F. Heide ‘Dirty Pixels: Optimizing Image Classification Architectures for Raw Sensor Data’, arXiv preprint arXiv:1701.06487.

SK하이닉스는 이처럼 지속적인 소자 및 공정 기술 개발을 통해 CIS 화소 집적도를 높이고 있으며, ISP 기술 개발을 통해 다양한 응용 분야를 지원하고 있다. 특히 새로운 기술 분야를 개척하기 위해 일본 및 미국에 해외 연구소를 설립해 운영하고 있다. 또한, 국내외 대학과의 활발한 산학협력을 통한 연구도 진행하고 있다. 앞으로 SK 하이닉스의 CIS는 스마트폰 카메라를 비롯한 다양한 응용 분야에 활용돼 경제·사회적 가치 창출에 기여하고, 향후 인포메이션 센서의 핵심 부품으로 성장할 것으로 기대된다.